- Authors

- Name

- 오늘의 바이브

56.8%에서 57.7%로, 그게 전부다

2026년 3월 5일, OpenAI가 GPT-5.4를 출시했다. "가장 강력하고 효율적인 프론티어 모델"이라는 수식어가 붙었다. 공식 블로그에는 벤치마크 차트가 가득하고, 연구원 Noam Brown은 "벽은 보이지 않는다(We see no wall)"고 선언했다.

그런데 숫자를 들여다보면 이야기가 달라진다. SWE-bench Pro에서 GPT-5.4의 점수는 **57.7%**다. 직전 코딩 특화 모델 GPT-5.3 Codex는 **56.8%**였다. 차이는 0.9%p. 반올림하면 1%다. GPT-5.2가 **55.6%**였으니, 두 세대를 거쳐 올라간 폭은 고작 2.1%p다.

SWE-bench Pro는 실제 오픈소스 프로젝트의 이슈를 해결하는 능력을 측정하는 벤치마크다. 단순히 코드를 생성하는 것이 아니라, 이슈를 이해하고 적절한 파일을 찾아 수정한 뒤 테스트를 통과시켜야 한다. 실무 코딩 능력의 가장 신뢰할 수 있는 지표 중 하나다. 거기서 1%가 올랐다.

코딩이 아닌 곳에서 점수가 뛰었다

GPT-5.4의 진짜 성적표는 코딩 밖에 있다. OpenAI가 내세우는 숫자들을 보면 방향이 보인다.

| 벤치마크 | GPT-5.2 | GPT-5.4 | 변화 |

|---|---|---|---|

| SWE-bench Pro | 55.6% | 57.7% | +2.1%p |

| OSWorld-Verified (데스크톱 조작) | 47.3% | 75.0% | +27.7%p |

| GDPval (지식 업무) | 70.9% | 83.0% | +12.1%p |

| 스프레드시트 모델링 | 68.4% | 87.3% | +18.9%p |

| BrowseComp (웹 검색) | 65.8% | 82.7% | +16.9%p |

| ARC-AGI-2 | 52.9% | 73.3% | +20.4%p |

패턴이 선명하다. 코딩은 거의 제자리인데, 데스크톱 조작은 27.7%p, 스프레드시트는 18.9%p, 웹 검색은 16.9%p 뛰었다. OpenAI가 GPT-5.4에 쏟아부은 자원은 코딩이 아니라 업무 자동화에 집중됐다. 코드를 더 잘 짜는 모델이 아니라, 컴퓨터를 직접 조작해서 일을 하는 모델을 만든 것이다.

OSWorld-Verified에서 75.0%는 인간 기준선 72.4%를 넘어선 수치다. AI가 사람보다 데스크톱을 잘 다룬다는 뜻이다. 마우스를 클릭하고, 키보드를 입력하고, 스크린샷을 보고 다음 행동을 결정한다. 코딩보다 이쪽에서 돌파구가 열린 셈이다.

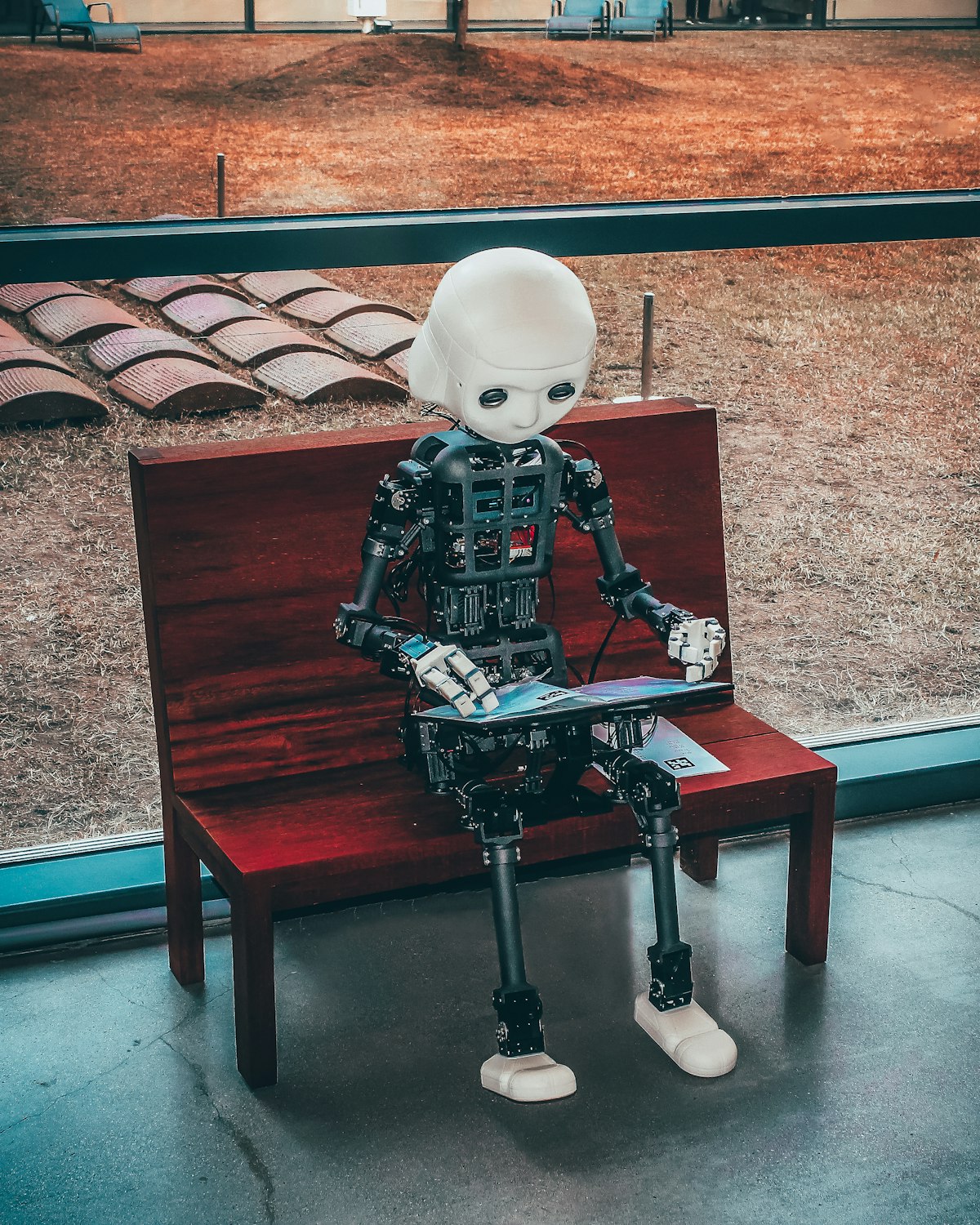

컴퓨터를 직접 조작하는 AI

GPT-5.4의 가장 큰 변화는 네이티브 컴퓨터 사용(computer use) 기능이다. OpenAI의 범용 모델 중 처음으로 이 기능이 탑재됐다. 두 가지 모드가 있다.

첫 번째는 코드 모드다. Python과 Playwright 라이브러리를 사용해서 브라우저를 조작한다. 웹사이트를 탐색하고, 폼을 채우고, 버튼을 클릭한다. 프로그래밍 방식으로 작동하기 때문에 정밀하고 빠르다.

두 번째는 스크린샷 모드다. 화면의 스크린샷을 보고 마우스와 키보드 명령을 직접 내린다. 사람이 컴퓨터를 쓰는 방식과 동일하다. 브라우저뿐 아니라 데스크톱 앱, 엑셀, 터미널 등 모든 애플리케이션에서 작동한다.

Anthropic의 Claude가 먼저 선보인 기능이다. Claude 3.5 Sonnet이 2024년 10월에 computer use 베타를 출시했다. OpenAI는 약 1년 반 뒤에야 범용 모델에 이 기능을 탑재한 것이다. 하지만 OSWorld-Verified 점수 75.0%는 현재 공개된 수치 중 가장 높은 편에 속한다. 후발주자가 점수로는 앞서는 구도다.

컨텍스트 윈도우도 100만 토큰으로 늘었다. GPT-5.3의 40만 토큰에서 2.5배 확장됐다. 다만 27만 2천 토큰을 초과하면 입력 비용이 2배, 출력 비용이 1.5배로 뛴다. 긴 컨텍스트는 가능하지만 비싸다.

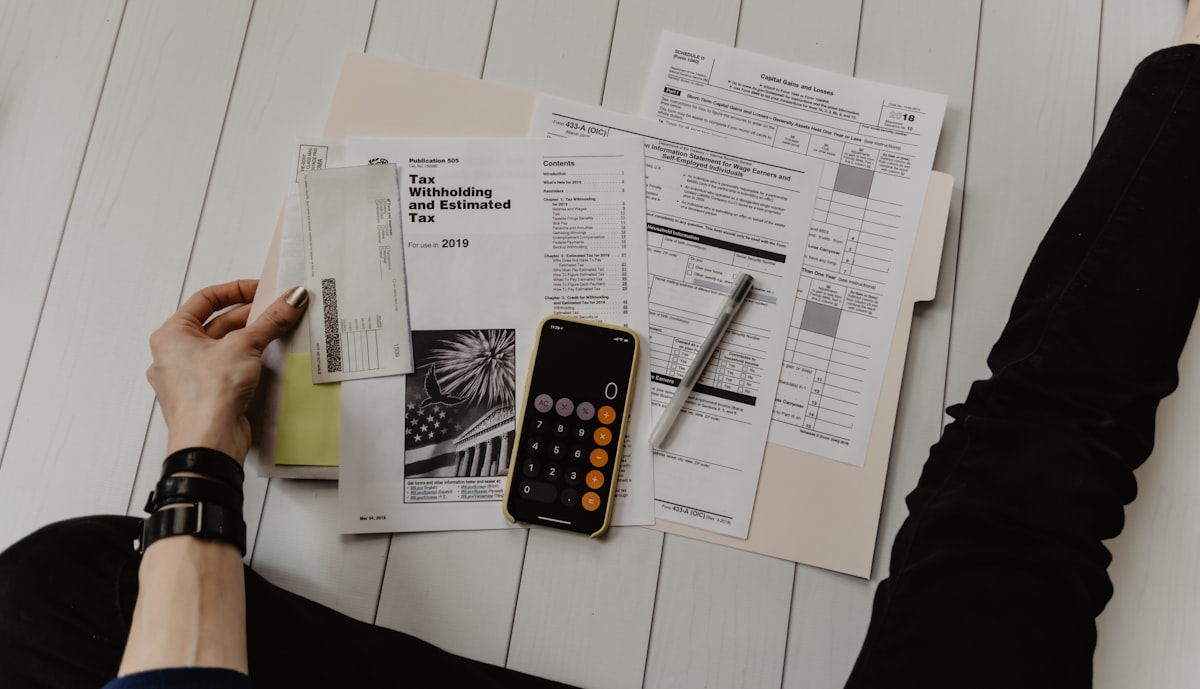

엑셀 플러그인이 의미하는 것

OpenAI는 GPT-5.4와 함께 ChatGPT for Excel and Google Sheets 베타를 발표했다. 스프레드시트에 ChatGPT가 직접 내장된다. 복잡한 재무 모델을 만들고, 수식을 작성하고, 시나리오 분석을 실행한다.

내부 투자은행 벤치마크에서 GPT-5.4의 스프레드시트 모델링 점수는 **87.3%**다. GPT-5.2는 68.4%였다. 거의 19%p가 올랐다. 이 벤치마크는 주니어 투자은행 애널리스트가 수행하는 작업을 기준으로 만들어졌다. DCF 분석, 비교 분석, 어닝스 프리뷰, 투자 메모 작성 같은 업무다.

금융 데이터 파트너도 추가됐다. Moody's, Dow Jones Factiva, MSCI, Third Bridge, MT Newswire 등의 데이터가 ChatGPT 안에서 직접 접근 가능하다. FactSet도 곧 추가된다. 재무 분석을 위해 별도로 터미널을 열 필요가 줄어든다.

Mercor CEO Brendan Foody는 GPT-5.4가 "슬라이드 덱, 재무 모델, 법률 분석 같은 장기 프로젝트형 결과물에서 탁월하다"고 평가했다. 핵심 단어는 "장기 프로젝트형 결과물"이다. 코드 한 줄이 아니라, 30페이지짜리 보고서를 만드는 능력이다.

이 방향을 보면 OpenAI의 전략이 드러난다. GPT-5.4는 개발자를 위한 모델이 아니다. 금융, 컨설팅, 법률 분야의 사무직을 겨냥한 모델이다. SWE-bench에서 1%를 올리는 것보다, 월스트리트 애널리스트의 엑셀 작업을 자동화하는 것이 돈이 된다는 판단이다.

가격표가 말해주는 것

GPT-5.4의 API 가격은 입력 15/1M 토큰이다. GPT-5.2(입력 14)보다 약 40% 비싸졌다. 그런데 진짜 가격은 Pro 버전에 있다.

| 모델 | 입력 (1M 토큰) | 캐시 입력 | 출력 (1M 토큰) |

|---|---|---|---|

| GPT-5.4 | $2.50 | $0.25 | $15 |

| GPT-5.4 Pro | $30 | — | $180 |

| Claude Opus 4.6 | $5 | — | $25 |

GPT-5.4 Pro는 입력 180이다. Claude Opus 4.6의 6배다. OpenAI는 이 가격을 정당화할 수 있다고 본 것이다. ARC-AGI-2에서 Pro는 83.3%(일반 73.3%), GPQA Diamond에서 94.4%(일반 92.8%), FrontierMath Tier 4에서 38.0%(일반 27.1%)를 기록했다. 최고 성능이 필요한 고객은 이 가격을 지불할 것이라는 계산이다.

캐시 입력 가격은 $0.25로 일반 입력의 10%다. 반복적인 재무 분석이나 에이전트 워크플로우에서는 이 캐시 할인이 실질적인 비용 절감으로 이어진다. Tool Search라는 새 기능은 대규모 도구 생태계에서 토큰 사용량을 47% 줄여준다. 비싼 모델의 비용을 다른 곳에서 깎아주는 구조다.

Codex에서 "/fast" 모드를 사용하면 토큰 속도가 1.5배 빨라진다. 품질 저하 없이. 속도와 비용, 두 가지를 동시에 잡으려는 시도지만, 기본 가격 자체가 오른 것은 사실이다.

"벽은 없다"는 말의 이면

Noam Brown의 "We see no wall" 발언을 다시 보자. 벽이 없다면 왜 SWE-bench Pro는 2%p밖에 안 올랐을까. 답은 간단하다. 벽은 코딩 쪽에 있다.

SWE-bench Pro에서 55.6% → 56.8% → 57.7%의 궤적은 전형적인 로그 곡선이다. 초기에는 빠르게 오르지만, 어느 지점부터 1%를 올리는 데 이전보다 훨씬 많은 자원이 든다. 반면 OSWorld(47.3% → 75.0%)나 ARC-AGI-2(52.9% → 73.3%)는 아직 가파른 상승 구간에 있다. 같은 연구 투자를 코딩에 쏟으면 1%가 오르고, 컴퓨터 사용에 쏟으면 28%가 오른다. 어디에 투자할지는 명백하다.

kilo.ai 블로그는 이 현상을 "선택적 벤치마크 보고(selective benchmark reporting)"라고 지적했다. OpenAI와 Anthropic 모두 자신에게 유리한 벤치마크 변형을 골라서 보고한다는 것이다. OpenAI는 SWE-bench Pro를 강조하고, Anthropic은 SWE-bench Verified를 강조한다. 같은 이름의 벤치마크지만 변형이 달라서 직접 비교가 어렵다.

GPT-5.4의 또 다른 약점도 보고됐다. kilo.ai는 GPT-5.4의 시그니처 실패 모드를 "작업을 정확히 이해하고 계획하지만, 마지막 실행 단계에서 멈추는 것(correctly understands and plans the task but halts before executing the critical final action)"이라고 설명했다. 건강 관련 벤치마크에서는 GPT-5.2의 63.3%에서 62.6%로 오히려 떨어졌다. "벽이 없다"는 선언은 OpenAI가 투자를 집중한 영역에서만 참인 셈이다.

사이버보안 "고위험" 등급의 의미

GPT-5.4는 OpenAI의 범용 추론 모델 중 처음으로 사이버보안 "High Capability" 등급을 받았다. 이 등급의 공식 의미는 "기존 사이버공격의 장벽을 제거할 수 있는(can remove existing barriers to cyberattacks)" 수준이라는 것이다.

OpenAI 스스로 자사 모델이 사이버 공격을 더 쉽게 만들 수 있다고 인정한 것이다. GPT-5.4 Thinking 버전에는 이에 대한 완화 조치가 포함되어 있다고 밝혔지만, 구체적인 내용은 공개하지 않았다.

보안 시스템으로는 실시간 메시지 레벨 차단기를 도입했다. 두 단계로 작동한다. 첫째, 주제 분류기가 메시지를 분석한다. 둘째, AI 보안 분석가가 추가 검토한다. 환각(hallucination)은 GPT-5.2 대비 개별 주장 오류가 33% 감소했고, 전체 응답 오류가 18% 감소했다. 더 정확해졌지만, 동시에 더 위험해졌다는 평가를 받는 모델이다.

이 역설은 AI 산업 전반의 딜레마를 보여준다. 모델이 유능해질수록 악용 가능성도 높아진다. GPT-5.4가 데스크톱을 조작하고, 엑셀을 만들고, 웹을 검색하는 능력은 업무 자동화에도 쓰이지만, 피싱 캠페인 자동화에도 쓰일 수 있다. "High Capability" 등급은 경고이자 마케팅이다.

코딩 모델의 시대는 끝나는가

GPT-5.4의 출시를 코딩 벤치마크만으로 평가하면 실망스럽다. 0.9%p는 통계적 노이즈에 가까운 수치다. 하지만 OpenAI가 만든 것은 코딩 모델이 아니다. 컴퓨터를 사용하는 모델이다.

이 구분이 중요하다. 지금까지 AI 코딩 도구의 경쟁은 "누가 SWE-bench에서 더 높은 점수를 받느냐"였다. Claude Opus 4.6이 SWE-bench Verified에서 **79.2%**로 1위를 차지하고 있고, GPT-5.4는 **77.2%**로 뒤를 쫓고 있다. 하지만 OpenAI는 이 경쟁에서 한 발 빼고, 대신 "AI가 사람처럼 컴퓨터를 쓸 수 있느냐"라는 다른 경쟁으로 판을 옮기고 있다.

코딩 특화는 GPT-5.3 Codex에 남겨뒀다. Terminal-Bench 2.0에서 GPT-5.3 Codex는 **77.3%**로 GPT-5.4의 75.1%를 앞선다. 순수 코딩 작업에서는 여전히 전용 모델이 더 낫다. GPT-5.4는 범용 모델이 되면서 코딩 전문성을 일부 양보한 것이다.

GPT-5.2 Thinking 모델은 출시일로부터 90일 뒤인 2026년 6월 5일에 은퇴한다. 레거시 모델을 정리하면서 GPT-5.4로 통합하겠다는 뜻이다. 범용 모델 하나로 코딩, 추론, 컴퓨터 사용, 재무 분석을 모두 커버하는 구조다.

질문은 이것이다. AI 모델의 가치가 "코드를 얼마나 잘 짜느냐"에서 "업무를 얼마나 잘 대체하느냐"로 이동하고 있다면, SWE-bench 1위가 여전히 의미 있는 지표인가. OpenAI의 대답은 명확하다. SWE-bench에 1%를 투자하는 대신, 엑셀에 19%를 투자하겠다는 것이다. 개발자의 눈에는 실망이고, 월스트리트의 눈에는 혁신이다.

출처

- OpenAI launches GPT-5.4 with native computer use mode, financial plugins for Microsoft Excel, Google Sheets — VentureBeat

- GPT-5.4: Computer Use, Tool Search, Benchmarks, Pricing — Digital Applied

- GPT-5.4 Lands with Computer Use and 1M Token Context — Awesome Agents

- GPT-5.4 Targets Anthropic's Claude With Premium Pricing and Coding Muscle — Trending Topics

- Benchmarking the Benchmarks: New GPT and Claude Releases — kilo.ai

- OpenAI launches GPT-5.4 Thinking and Pro — The Decoder

- OpenAI releases GPT-5.4 with native computer use — TechInformed